A estas alturas, todo el mundo ha visto o utilizado un modelo de inteligencia artificial, como DeepSeek, ChatGPT o Copilot. La IA ha permeado todas y cada una de las capas y sectores de nuestra sociedad, sin excepción. Esto ha provocado que perfiles de todo tipo tengan acceso a herramientas que, si bien mejoran la productividad, también conllevan graves riesgos de seguridad. Riesgos que pueden llevar tanto a adolescentes como a adultos a infectar nuestros equipos y dispositivos, poniendo en peligro nuestra privacidad e integridad. Siendo los más cruciales:

1. Alucinaciones de IA: Información Insegura o Dañina

Uno de los mayores desafíos de los modelos de IA es el fenómeno conocido como «alucinaciones». Si un modelo de IA no cuenta con filtros adecuados, puede generar información errónea, peligrosa o insegura. Por ejemplo, los enlaces de phishing podrían aparecer entre los primeros resultados de búsqueda, lo que pone en peligro la integridad de la información proporcionada.

Fuente: Europa Press

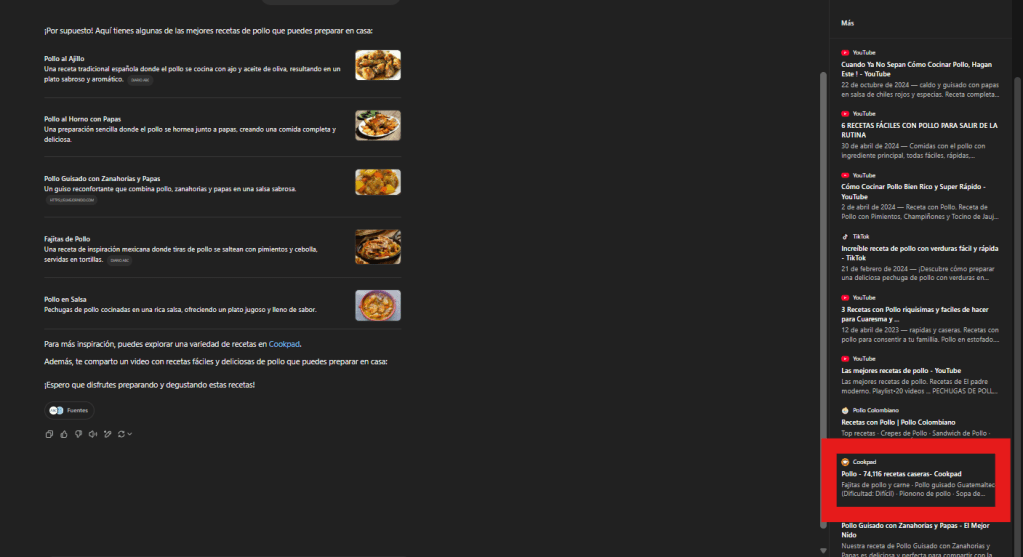

2. Riesgo en la Búsqueda Web con IA: Acceso Accidental a Enlaces Fraudulentos

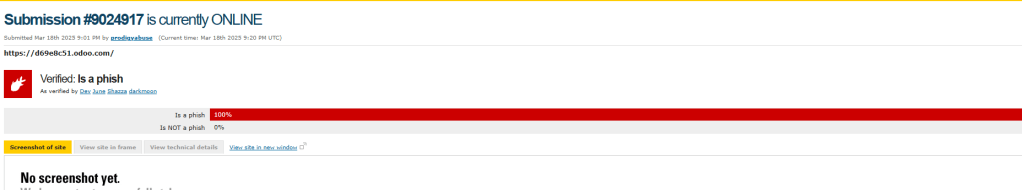

El uso de la función de búsqueda web integrada en modelos de IA como ChatGPT facilita el acceso a información actualizada a través de enlaces a fuentes externas. Sin embargo, este sistema hereda los mismos riesgos de los motores de búsqueda tradicionales, ya que puede incluir enlaces fraudulentos que, si no se detectan, pueden llevar a los usuarios a sitios web maliciosos.

En el siguiente ejemplo práctico, le pedí a ChatGPT recetas de pollo. Mi sorpresa fue cuando, entre las respuestas, una de las páginas no correspondía al enlace previsualizado en la receta. Al hacer clic en él, fui redirigido a una página catalogada como phishing y considerada peligrosa según la base de datos de Phistank. Este incidente resalta la importancia de verificar las fuentes de los enlaces proporcionados por los motores de IA generativa

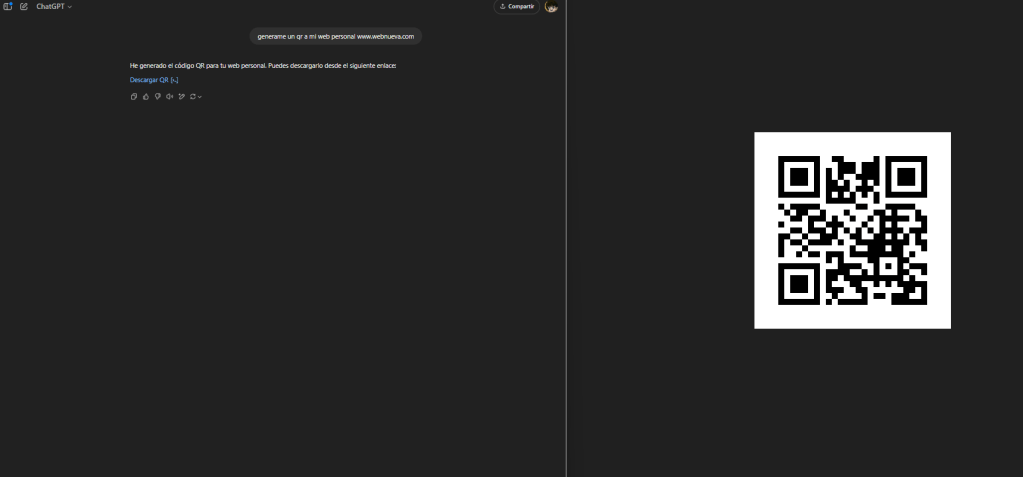

3. Códigos QR: Enlaces Maliciosos Ocultos

Los modelos de IA generativa, como ChatGPT, tienen la capacidad de crear códigos QR a partir de información o enlaces. Aunque esta funcionalidad es útil para compartir información de manera rápida, también presenta un riesgo significativo: los códigos QR pueden redirigirnos a sitios web maliciosos, como páginas de phishing o sitios destinados a descargar malware. Si los modelos de IA no tienen filtros de seguridad adecuados, podrían generar códigos QR que contengan enlaces fraudulentos sin que nos demos cuenta

¿Cómo protegernos?

Afortunadamente, existen diversas herramientas que pueden ayudarnos a protegernos de estos riesgos. Y sí, son todas de acceso libre y gratuito:

- Escanear Códigos QR para Detectar Enlaces Maliciosos: Utilizaremos aplicaciones que escanean códigos QR y previsualizan los sitios web a los que conducen, antes de hacer clic en ellos.

Android: QR Code Reader

Apple: Qrafter QR Code Reader

- Herramientas para Verificar Enlaces de ChatGPT: Antes de hacer clic en un enlace proporcionado por un modelo de IA, como ChatGPT, podemos utilizar herramientas que verifican la seguridad de los sitios web. A continuación dejo algunas de las más fiables, las cuales se alimentan con datos de usuarios y verificaciones de expertos en seguridad informática de todo el mundo:

PhishTank: www.phishtank.com

ScamAdviser: www.scamadviser.com

URLVoid: https://www.urlvoid.com/

Conclusión: No es oro todo lo que reluce

La IA, sin duda, ha transformado muchos aspectos de nuestra vida diaria, incluyendo la educación y la productividad. Sin embargo, como cualquier herramienta poderosa, presenta riesgos significativos que, si no estamos atentos, pueden aprovechar nuestra confianza en herramientas tan sumamente versátiles. Desde alucinaciones de IA hasta ataques de phishing avanzados, es crucial que todo el mundo esté al tanto de los peligros y tome las medidas adecuadas para protegerse.

Al implementar prácticas de seguridad, como escanear códigos QR, verificar enlaces antes de hacer clic y utilizar herramientas de análisis de URLs, podemos mitigar el riesgo de caer en las trampas de los ciberdelincuentes. Lo que nunca puede primar, desde luego, es la confianza ciega en una solución tecnológica. Pues no existe (y probablemente no existirá) sistema que sea completamente seguro, al menos mientras nuestro cerebro, siempre imperfecto, esté en la ecuación.

Descubre más desde El rincón de Alberto y Leti

Suscríbete y recibe las últimas entradas en tu correo electrónico.

Me gusta mucho el artículo. Voy a estar pendiente a partir de ahora. Llevo mucho utilizando la IA pero nunca me había percatado de estas cosas

Muchas gracias

PD: Gracias a EddyLane/Leti por impulsarle a escribir, es un tesoro

Me gustaLe gusta a 1 persona

Absolutamente increíble a todos los niveles. Explicativo, con soluciones concretas y muy bien escritos. Mi más sincera felicitación

Bien hecho, Alberto!

Me gustaMe gusta